Shadow AI : la nouvelle menace invisible dans les entreprises ?

Face à la prolifération d’IA génératives non validées par les DSI, les systèmes d’information perdent en maîtrise ce qu’ils gagnent en agilité. Le Shadow AI, discret, polymorphe, s’infiltre par les besoins métiers non couverts, les process contournés, les outils trop permissifs.

À la frontière du risque et de l’innovation, il soulève des enjeux de gouvernance, de sécurité et de souveraineté numérique. Décryptage d’un phénomène qui n’a désormais plus rien de marginal.

Mais d’abord, c’est quoi au juste le « Shadow AI » ?

Le Shadow AI désigne l’ensemble des usages d’intelligences artificielles non validés, non encadrés, voire totalement ignorés par la DSI. Autrement dit, toute IA générative ou assistante exploitée par un collaborateur sans supervision technique formelle ni politique de gouvernance claire. Elle agit dans les marges du SI, souvent par nécessité opérationnelle ou curiosité individuelle.

À première vue, ce phénomène semble calqué sur le Shadow IT : même logique d’échappement, mêmes causes structurelles. Mais les implications du Shadow AI creusent un sillon bien plus profond.

Là où le Shadow IT installe des outils, le Shadow AI instille des décisions. Il ne se contente pas de contourner les règles : il modifie les contenus, les processus, voire les lignes de responsabilité.

Origines et moteurs de propagation

Le Shadow AI découle à tout le moins d’un écosystème technologique en mutation rapide, d'une pression opérationnelle constante, et d’un retard structurel des politiques internes de gouvernance.

Trois leviers expliquent sa diffusion virale :

L’accessibilité sans précédent des IA génératives. ChatGPT, DALL·E, MidJourney, Claude : ces outils s’activent en trois clics, parfois même sans inscription. L’entrée dans l’ère du prompt engineering s’est faite sans sas d’intégration.

Le décalage entre les attentes des métiers et les réponses de la DSI. Procédures d’homologation trop rigides, cloisonnement des outils, politiques de sécurité contraignantes : autant d’éléments qui encouragent les collaborateurs à chercher des raccourcis.

L’impératif d'efficacité immédiate. Générer un contenu marketing en 5 minutes. Prototyper un bout de code. Traduire un mail. Résumer un contrat. En l’absence d’alternatives internes viables, les IA externes s’imposent.

Les formes que prend le Shadow AI dans les entreprises

Le Shadow AI ne prend pas toujours les traits d’un ChatGPT en pleine rédaction. Elle adopte des formes variées, parfois invisibles, souvent banalisées.

Parmi les cas les plus fréquents :

Les automatisations personnelles : génération de scripts via IA, automatisation de tâches récurrentes avec Zapier ou Make, sans supervision ni documentation.

La production de contenu ou d’éléments de code : prompts insérés dans ChatGPT ou Copilot pour rédiger des rapports, créer des emails, développer des fonctionnalités.

Les plugins IA invisibles : IA intégrées à Microsoft 365, Notion, Canva, Slack… activées en un clic, sans validation IT (souvent activées par défaut).

Dans bien des cas, les utilisateurs ignorent même qu’ils déclenchent une IA. Ce flou fonctionnel accentue la difficulté de recensement et d’audit.

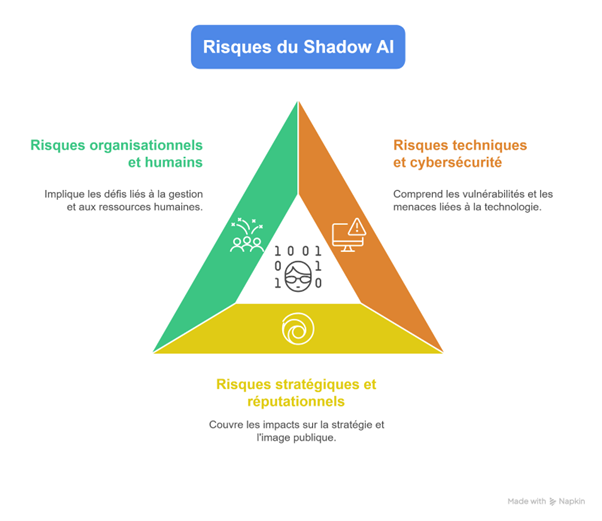

Quels sont les risques du Shadow AI ?

1️⃣ Risques techniques et cybersécurité

Le Shadow AI introduit une surface d’attaque que la plupart des RSSI ne surveillent pas encore.

Chaque prompt envoyé à une IA publique emporte potentiellement des données confidentielles : structure interne d’une base client, fragment de code propriétaire, stratégie produit, éléments RH, etc. À la moindre négligence, ces contenus s’inscrivent dans des modèles d’IA hébergés à l’extérieur, souvent sans chiffrage ni clause de non-rétention.

Les outils d’IA utilisés à la marge échappent aux standards de conformité. RGPD, ISO 27001, SOC 2, NIS 2 : les IA grand public n’entrent dans aucun de ces cadres. Leurs conditions d’utilisation varient, se complexifient, et restent largement opaques pour les utilisateurs.

Par ailleurs, certains outils intègrent des modèles open source non vérifiés ou s’appuient sur des bibliothèques tierces vulnérables. L’absence de code review, de sandbox sécurisée ou de contrôle de version fait de ces IA clandestines un point d’entrée redoutable pour des attaques indirectes (type supply chain).

2️⃣ Risques stratégiques et réputationnels

L’automatisation sans traçabilité génère des décisions opaques, parfois biaisées. Quand une IA non encadrée rédige un courrier juridique, suggère un choix technique ou classe des candidatures, qui porte la responsabilité en cas d’erreur ? Où se trouve la preuve de l’action ? Quelle logique a mené au résultat ? Bien souvent, aucune trace n’en subsiste.

Autre dérive préoccupante : la perte de contrôle sur la propriété intellectuelle. Un code généré par une IA tierce conserve-t-il des droits d’auteur implicites ? Rien n’est clair encore aujourd’hui. Et lorsque les modèles s'entraînent en partie sur les productions des utilisateurs, l’originalité de la création devient discutable.

Enfin, l’IA génère parfois du faux. Volontairement ou non. Ces fameuses hallucinations — documents inventés, sources fausses, chiffres erronés — peuvent nourrir des présentations stratégiques, des livrables client, voire des décisions financières. La fiabilité perçue de l’entreprise s’érode à mesure que les erreurs s’accumulent.

3️⃣ Risques organisationnels et humains

Enfin, le Shadow AI fragilise les fondamentaux de la gouvernance d’entreprise. À commencer par la traçabilité des actions. Lorsqu’une décision s’appuie sur une IA non déclarée, aucun audit ne peut reconstituer la logique de traitement. La chaîne de validation devient poreuse, voire inexistante.

Cette dérive accentue un autre phénomène : la fracture numérique interne. Certains profils — développeurs, data analysts, marketing — adoptent très tôt les IA. D’autres, plus éloignés des technos ou dépendants de processus stricts, restent à l’écart. Résultat : deux vitesses dans l’organisation, deux cultures, deux logiques de production.

Enfin, la délégation excessive à des outils automatiques nourrit un biais de déresponsabilisation. Le raisonnement cède parfois la place à l’habitude. L’IA devient une béquille, puis une norme. Or, une IA ne pense pas. Elle calcule. Sans esprit critique, sans nuance, sans conscience métier.

Au-delà de la menace : transformer le Shadow AI en levier stratégique ?

Shadow AI comme révélateur d’un besoin d’agilité

À force de le combattre, on oublie ce que le Shadow AI révèle. Il fonctionne comme un thermomètre silencieux de la maturité numérique d’une organisation.

Là où il surgit, c’est souvent parce qu’il manquait quelque chose : un outil, une autonomie, une réponse métier rapide. L’IA comble une attente insatisfaite. Ni plus ni moins.

Les usages « sous le radar » traduisent une volonté d’innover, pas de tricher. C’est la raison pour laquelle il devient urgent de cartographier ces zones grises, non pour les censurer, mais pour les comprendre. Ces signaux faibles forment le début d’un terrain fertile : celui de l’innovation bottom-up.

En analysant ce que les collaborateurs automatisent, contournent ou créent via des IA non validées, les DSI peuvent dresser une heatmap de l’agilité organique. Ces zones d’expérimentation constituent souvent les premiers jalons d’un SI plus réactif, plus ancré dans les réalités métiers.

Valoriser les expérimentations internes

Tout usage illégal n’est pas illégitime, donc. Derrière certains détours techniques se cachent des initiatives brillantes, des prototypes utiles, des briques réutilisables. Plutôt que de les enterrer sous le tapis de la conformité, certaines entreprises choisissent de les reconnaître — et de les faire grandir.

Exemple : une équipe support client qui génère ses scripts de réponse avec ChatGPT, et qui observe une baisse du temps de traitement. Ou un développeur qui automatise le nettoyage de logs avec un prompt personnalisé. Une fois identifiés, ces usages méritent d’être examinés, encadrés, industrialisés.

Intégrer l’IA dans les processus métier en continu

Le risque du Shadow AI diminue à mesure que l’IA s’intègre. Pas comme une surcouche imposée, mais comme une brique native du quotidien opérationnel. CRM, ERP, ATS, helpdesk, marketing automation : tous ces outils deviennent des points d’entrée pour des IA « invisibles mais gouvernées ».

L’enjeu n’est pas d’imposer une IA unique, mais d’orchestrer un écosystème d’IA aligné sur la stratégie. Cette approche fédère, canalise, sécurise. Et elle envoie un signal fort : l’IA ne se vit plus en périphérie, elle devient un copilote pleinement intégré.

Conclusion : gérer l’invisible pour rester maître du visible

Le Shadow AI n’est pas un bug dans le système. Elle en est un symptôme.

Elle expose des failles, mais révèle aussi un potentiel. Un besoin d’autonomie. Une volonté d’innovation. Une frustration technologique !

Plutôt que de l’éradiquer, pourquoi ne pas la canaliser ? En combinant rigueur, écoute et agilité, les entreprises peuvent transformer ce risque diffus en avantage compétitif clair.

Commentaire

Connectez-vous ou créez votre compte pour réagir à l’article.